| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | 2 | 3 | 4 | |||

| 5 | 6 | 7 | 8 | 9 | 10 | 11 |

| 12 | 13 | 14 | 15 | 16 | 17 | 18 |

| 19 | 20 | 21 | 22 | 23 | 24 | 25 |

| 26 | 27 | 28 | 29 | 30 | 31 |

- javascript

- 함수

- LIST

- Github

- Spring

- db

- Deep

- data

- framework

- Linux

- 인공지능

- Server

- mysql

- Python

- learning

- 자바

- mariaDB

- ai

- Analysis

- git

- Pattern

- java

- error

- interface

- centos

- DeepLearning

- SSH

- Security

- Web

- Numpy

- Today

- Total

목록learning (8)

PostIT

# [AI/Deep Learing] Deep Learning 준비하기 - MNIST Load Data - 5-1import sys, os sys.path.append(os.pardir) import numpy as np import pickle from dataset.mnist import load_mnist from common.functions import sigmoid, softmax def get_data(): (x_train, t_train), (x_test, t_test) = load_mnist(normalize=True, flatten=True, one_hot_label=False) return x_test, t_test def init_network(): with open("sample_w..

# [AI/Deep Learing] Deep Learning 준비하기 - MNIST DataSet - 5import sys, os sys.path.append(os.pardir) import numpy as np import pickle from dataset.mnist import load_mnist from common.functions import sigmoid, softmax from PIL import Image # MNIST 간단히 이미지 출력해보기. #파일 다운로드 # normalize : 0.0 ~ 1.0 사이로 정규화 할지 여부, Fasle = 0 ~ 255 # flatten : 1차원 배열로 만들지 여부 # one_hot_lable : 정답을 뜻하는 원소만 1, 나머지는 0으로 설정할지..

# [AI/Deep Learing] Deep Learning 준비하기 - 순방향 3층 신경망 구현 - 4 # 이번 절의 핵심은 신경망에서의 계산을 행렬계산으로 정리할 수 있다는 것입니다. import numpy as np # 입력층 ==> 1층 # x 입력 값, b1 편향(활성화 함수), w 가중치(12) x = np.array([1.0, 0.5]) w1 = np.array([[0.1, 0.3, 0.5], [0.2, 0.4, 0.6]]) b1 = np.array([0.1, 0.2, 0.3]) print(w1.shape) print(x.shape) print(b1.shape) (2, 3) (2,) (3,) a1 = np.dot(x, w1) + b1 # 시그모이드 함수 구현하기 def sigmoid(x): ..

# [Python/Data Analysis] Numpay - Universal Array Function - Day 7import numpy as np arr =np.arange(11)arr array([ 0, 1, 2, 3, 4, 5, 6, 7, 8, 9, 10]) np.sqrt(arr) array([ 0. , 1. , 1.41421356, 1.73205081, 2. , 2.23606798, 2.44948974, 2.64575131, 2.82842712, 3. , 3.16227766]) A = np.random.randn(10)A array([-0.66405485, 0.28749254, 0.27305696, 0.22232217, 0.8804781 , 1.01018702, -0.15188718, -0.7..

# [Python/Data Analysis] Numpay - Array Tranposition 사용하기 - Day 6import numpy as np arr = np.arange(50).reshape((10,5)) arr array([[ 0, 1, 2, 3, 4], [ 5, 6, 7, 8, 9], [10, 11, 12, 13, 14], [15, 16, 17, 18, 19], [20, 21, 22, 23, 24], [25, 26, 27, 28, 29], [30, 31, 32, 33, 34], [35, 36, 37, 38, 39], [40, 41, 42, 43, 44], [45, 46, 47, 48, 49]]) arr.T array([[ 0, 5, 10, 15, 20, 25, 30, 35, 40, 45], ..

[AI/Deep Learing] 인공지능을 위한 Deep Learning 준비(다차원 배열의 계산) - 3

[AI/Deep Learing] 인공지능을 위한 Deep Learning 준비(다차원 배열의 계산) - 3

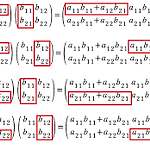

# [AI/Deep Learing] 인공지능을 위한 Deep Learning 준비(다차원 배열의 계산) - 3 이번에는 신경망에서 필요한 다차원 배열에 대해서 알아보겠습니다. ## 다차원 배열 숫자가 한 줄로 늘어선 것이나 직사각형으로 늘어 놓은 것, 3차원으로 늘어놓은 것, N차원으로 나열하는 것을 통틀어 다차원 배열이라고 합니다. ### 1. 다차원 배열을 구현해보겠습니다. import numpy as np a = np.array([1,2,3,4]) print(a) [1 2 3 4] # 배열의 차원 수 확인하기. np.ndim(a) 1 # shape는 튜플을 반환 a.shape (4,) a.shape[0] 4 b = np.array([[1,2],[3,4],[5,6]]) print(b) [[1 2] [..

[AI/Deep Learing] 인공지능을 위한 Deep Learning 준비(시그모이드 & ReLU 함수 구현하기) - 2

[AI/Deep Learing] 인공지능을 위한 Deep Learning 준비(시그모이드 & ReLU 함수 구현하기) - 2

# [AI/Deep Learing] 인공지능을 위한 Deep Learning 준비(신경망을 위한 시그모이드 함수 구현하기) - 2 1일차에서 퍼셉트론과 계단함수에 대해 알아봤습니다. 이번에는 계단함수와 시그모이드 함수를 비교해보겠습니다. 1일차 계단함수 ## 시그모이드 함수 구현하기import numpy as np import matplotlib.pylab as plt def sigmoid(x): return 1 / (1 + np.exp(-x)) x = np.array([-1.0, 1.0, 2.0]) sigmoid(x) array([ 0.26894142, 0.73105858, 0.88079708]) t = np.array([1.0,2.0,3.0]) 1.0 + t array([ 2., 3., 4.]) 1...

[AI/Deep Learing] 인공지능을 위한 Deep Learning 맛 보기 공부(Perceptron과 신경망) - 1

[AI/Deep Learing] 인공지능을 위한 Deep Learning 맛 보기 공부(Perceptron과 신경망) - 1

# [AI/Deep Learing] 인공지능을 위한 Deep Learning 준비(Perceptron과 신경망) - 1 ## 퍼셉트론(perceptron) 인공신경망의 한 종류로서, 1957년에 코넬 항공 연구소(Cornell Aeronautical Lab)의 프랑크 로젠블라트 (Frank Rosenblatt)에 의해 고안되었다. 이것은 가장 간단한 형태의 피드포워드(Feedforward) 네트워크 - 선형분류기- 으로도 볼 수 있다. 퍼셉트론이 동작하는 방식은 다음과 같다. 각 노드의 가중치와 입력치를 곱한 것을 모두 합한 값이 활성함수에 의해 판단되는데, 그 값이 임계치(보통 0)보다 크면 뉴런이 활성화되고 결과값으로 1을 출력한다. 뉴런이 활성화되지 않으면 결과값으로 -1을 출력한다. 마빈 민스키와..